Documentation Index

Fetch the complete documentation index at: https://lovable.generaltranslation.app/llms.txt

Use this file to discover all available pages before exploring further.

Lovable における SEO と GEO の仕組み

組み込みの Speed ツール

独自ドメイン

- 自分のドメインまたはサブドメインを接続する

- 1 つの プライマリドメイン を選択する(他のすべてのドメインはそこへリダイレクトされます)

Lovable のアーキテクチャを理解する

SEO と GEO にとっての意味

- 最初の HTML をクロールしてページ構造を収集する

- 後から再度アクセスして JavaScript (JS) をレンダリングし、ページ全体のコンテンツを取得する

- インデックス作成に 少し時間がかかる(数時間ではなく数日かかることがある)

- 新しいページが検索結果に表示されるまで時間がかかることがある

- ランキング自体に悪影響が出ることはなく、影響するのはインデックス作成の速度だけ

- Facebook、X/Twitter、LinkedIn などのプラットフォームは、コンテンツがレンダリングされるのを待たないため、初期の HTML ページ構造しか取得しません。

- すべてのページが同じ基本タイトルとプレビュー画像を共有している場合、ソーシャルリンクには汎用的または誤った情報が表示されることがあります

- 多くの AI システムは動的にレンダリングされたコンテンツを確実には取得できないため、ページを見逃したり、一部のコンテンツしか認識できないことがあります

基本設定: サイトをクロール可能にする

XML サイトマップ

sitemap.xml を生成できます。

sitemap.xml の実装と検証方法

sitemap.xml の実装と検証方法

すべての公開ルートを列挙した XML サイトマップを /sitemap.xml に作成してください。lastmod 日付と優先度を含めてください。ホームページ 1.0、主要ページ 0.8、ブログ記事 0.6 とします。検証

- サイトマップファイルが公開されるようにプロジェクトを公開する

-

https://yourdomain.com/sitemap.xmlでアクセス可能か確認する(XML が返されること) - 主要なルート(ホーム、主要ページ、ブログ、商品)がすべて含まれているか確認する

-

コンテンツが変更されたら

lastmodを更新する -

priorityを使って重要度を示す(0.0~1.0) - Google Search Console と Bing Webmaster Tools に送信する

-

ページを追加・削除したら、サイトマップを再生成して再送信する(自動ではありません)。たとえば、次のようにプロンプトします:

sitemap.xml を更新して /new-page を追加し、/old-page を削除したうえで、Google Search Console に再送信してください。

Robots.txt

robots.txt は、検索エンジンに対してサイト内のどの範囲をクロールしてよいかを伝えるファイルです。Google がページを正しくレンダリングするために必要な重要なリソースをブロックしないことが重要です。Lovable Agent に依頼すれば、robots.txt ファイルを作成できます。

robots.txt の実装と検証方法

robots.txt の実装と検証方法

/public/robots.txt に、すべてのクローラーを許可し、Sitemap: https://yourdomain.com/sitemap.xml を参照し、AI の可視性のために GPTBot と PerplexityBot を許可する robots.txt を作成してください。検証

https://yourdomain.com/robots.txtでアクセスできることを確認する- CSS、JavaScript、または

/assets/フォルダを絶対にブロックしない - サイトマップを指し示す

Sitemap:行を含める - 戦略に基づいて AI ボット(GPTBot、PerplexityBot)へのアクセスを制御する

カノニカルタグの実装と確認方法

カノニカルタグの実装と確認方法

すべてのページに、そのページ自身の URL を指すカノニカルタグを追加してください。末尾にスラッシュを付けず、https://yourdomain.com 形式を使用してください。確認

-

各ページを確認し、ブラウザのコンソールに次を貼り付けます:

- 1ページにつきカノニカルタグが ちょうど1つ 存在することを確認します。

- 希望するドメインと URL のバリアント(HTTPS、末尾スラッシュの有無)と一致していることを確認します。

- 意図的な場合(例: フィルタ済みの商品ビュー)を除き、異なるページが同じカノニカルを指すようにしないでください。

クリーンなURLとルーティング

クリーンなURLの実装と検証方法

クリーンなURLの実装と検証方法

すべてのルートを確認し、URLがクリーンで内容をよく表していることを確認してください。単語の区切りにはハイフンを使用し、クエリパラメータは避けてください。検証方法

- 各ルートにアクセスし、ブラウザーのコンソールにエラーがないか確認する

- URLは安定していて、内容を表しており、ランダムなIDを含まないこと

- サイト全体で形式を統一する(末尾スラッシュの有無、

wwwの有無) - すべてのルートがJavaScriptエラーなしで読み込まれること

内部リンク

内部リンクを実装して検証する方法

内部リンクを実装して検証する方法

関連ページへのコンテキストに沿った内部リンクを 3〜5 個追加してください。「ここをクリック」ではなく、内容を表す説明的なアンカーテキストを使ってください。検証

-

リンクがクロール可能であることを確認します。数はナビゲーションとコンテンツから想定されるリンク数とおおよそ一致しているはずです。

-

onClickハンドラーではなく、実際の<a href>タグを使用すること - 重要なページには、複数の内部リンクが集まっていること

- サイト全体に表示されるよう、最も重要なページへのリンクをフッターに含めること

-

アンカーテキストは、「click here」のような文言ではなく、キーワードを含んだ内容がわかるものにすること

- 良いアンカーテキスト:

organic dog food benefits - 良くないアンカーテキスト:

click here,read more

- 良いアンカーテキスト:

- ホームページから 3 クリック以内で深い階層のページに到達できること

オンページSEO:検索エンジンがコンテンツを理解できるようにする

ページタイトル

ページタイトルの実装と検証方法

ページタイトルの実装と検証方法

すべてのルートのページタイトルを更新してください。各ページの目的に合った、わかりやすく説明的なタイトルを使用し、60文字以内に収めてください。検証

-

各ページのタイトル内容と文字数を確認します。ブラウザのコンソールに次を貼り付けます:

- 各ルートごとに固有で説明的なタイトルがあり、「Home」のような汎用的なタイトルがどこでも使われていないこと

- 60文字未満にして、検索結果でタイトルが省略されないようにすること

- 主要キーワードに加えてブランド名を含めること

メタディスクリプション

メタディスクリプションを実装・検証する方法

メタディスクリプションを実装・検証する方法

主要なすべてのページごとに、一意のメタディスクリプションを作成してください。各メタディスクリプションは明確で役立つ内容にし、140〜160文字の範囲に収めてください。検証方法

-

各ページのディスクリプションと文字数を確認します。次をブラウザコンソールに貼り付けて実行します:

-

各ページに一意のディスクリプションがあること(140〜160文字)

- 悪い例:

Welcome to our website(汎用的で、繰り返し使われている) - 良い例:

Premium organic dog food delivered fresh to your door. Free shipping over $50.(158文字)

- 悪い例:

- 利点、差別化ポイント、控えめな行動喚起が含まれている

- ページごとに重複していない

見出し構造(H1 → H3)

見出し構造を実装・検証する方法

見出し構造を実装・検証する方法

各ページの見出し構造を確認してください。ページの先頭に H1 を 1 つ、その下に主要なセクション用の H2、入れ子になったコンテンツ用の H3 を使用します。見出しレベルを飛ばさないでください。検証

-

H1 タグが 1 つだけであることを確認します。ブラウザのコンソールに次を貼り付けます。1 が返されるはずです:

-

見出しの内容を確認します。ブラウザのコンソールに次を貼り付けます:

- H1 に主要なキーワードが含まれており、ページの目的が明確に示されていること

- 見出しが論理的な順序になっていること(H1 → H2 → H3 の順で、レベルを飛ばさない)

- 見出しをスタイル目的だけで使用していないこと

セマンティック HTML

<main>、<nav>、<section> などのセマンティック要素を追加します。

セマンティック HTML を実装・検証する方法

セマンティック HTML を実装・検証する方法

HTML の構造を見直し、適切な箇所にセマンティックタグを使用してください。メインコンテンツは検証<main>、ナビゲーションは<nav>、セクションは<section>、フッターコンテンツは<footer>に配置してください。

- ブラウザのコンソールに次を貼り付けます。該当する場合は

trueが返ります:

- 各ページで次を確認してください:

- 単一の

<main>が主要コンテンツを囲んでいる - ナビゲーションが

<nav>内にある - フッターコンテンツが

<footer>内にある - 関連コンテンツが

<section>と<article>タグ内にある

- 単一の

画像の最適化

alt テキストを追加し、遅延読み込みを有効にできます。

画像最適化を実装して検証する方法

画像最適化を実装して検証する方法

すべての画像を確認し、わかりやすく具体的な alt テキストを追加してください。各画像に width と height 属性があり、高速表示のために適切に圧縮されていることを確認してください。検証

-

すべての画像に alt テキストがあることを確認します。これをブラウザコンソールに貼り付けて実行し、返り値が 0 になることを確認します:

-

altテキストの品質を評価します — 関連するキーワードを含んだ具体的な説明になっている必要があります- 悪い例:

alt="image"、alt="photo"、alt="" - 良い例:

alt="Golden retriever eating organic grain-free dog food from a bowl"

- 悪い例:

-

適切なファイル形式を使用し、ファイルサイズを小さく保ちます:

- 写真やイラストには WebP

- ロゴ、アイコン、シンプルな図には SVG

- 画像は 200KB 未満に圧縮

- width と height 属性が設定されていること(レイアウトシフトを防止)

- ターゲットキーワードでの順位を上げる

- より早くインデックスされる

- テーマに関する専門性・権威性を高める

- より大きな、または古いサイトと競合できるようにする

高品質な被リンクを構築する方法

高品質な被リンクを構築する方法

- リンクしたくなるコンテンツを作成する

- 詳細なガイド、チュートリアル、リサーチ

- データ、統計情報、または独自のインサイト

- インタラクティブなツール、計算ツール、ROI試算ツール

- テンプレート、チェックリスト、ダウンロード可能なアセット

- ゲスト投稿を公開する

- あなたのニッチ領域のブログに記事を寄稿する

- サイトへの文脈に合ったリンクを盛り込む

- 著者プロフィールでブランドの信頼性を強調する

- 補完関係にあるビジネスと提携する

- コンテンツを共同制作する(記事、ウェビナー、各種リソース)

- 関連ページ同士でクロスリンクする

- ディレクトリやリソースページに掲載してもらう

- 業界ディレクトリ

- ローカルビジネスリスティング

- スタートアップ向けリスティング

- あなたのプロダクトに関連するキュレーションリソース

- コンテンツをプロモートする

- ソーシャルプラットフォームで共有する

- ニュースレターに追加する

- インフルエンサー、ブロガー、顧客に言及してもらう

- 大きなアップデートやローンチ時には PR アウトリーチを行う

- 関連性が高い(同じトピックまたは業界)

- 権威性がある(信頼できるドメイン)

- 編集によって掲載が決まっている(お金ではなく、評価されて獲得したリンク)

- アンカーテキストが説明的(関連キーワードを自然に含んでいる)

- コンテキスト内に配置されている(実際のコンテンツ内で使われ、ランダムなフッターやサイドバーのリンクではない)

- スパム的な手法を避ける(リンクファーム、低品質ディレクトリ、有料リンクスキームなど)。これらはランキングを下げる原因になります。

リッチリザルト:検索結果で目立たせる

構造化データ(JSON-LD スキーマ)

Product: 価格、在庫状況、レビュー、評価Article: 著者、公開日、アイキャッチ画像FAQPage: 質問と回答LocalBusiness: 住所、電話番号、営業時間などのビジネス情報

構造化データの実装と検証方法

構造化データの実装と検証方法

Product スキーマを商品ページに追加し、名前、説明、価格、在庫状況、画像、ブランド、評価の詳細を含めてください。

検証- 主要なページ(例:ホーム、商品ページ、ブログ記事、FAQ ページ)で構造化データが入っているか確認します。次のコードをブラウザコンソールに貼り付けて実行します。意図的に複数のスキーマタイプを追加していない限り、1 が返されるはずです:

- Google リッチリザルトテスト で検証する

- エラーや必須項目の不足を修正する

- スキーマデータをページ上に表示されているコンテンツと常に一致させておく

Open Graph、Twitter Cards、OG 画像を実装・検証する方法

Open Graph、Twitter Cards、OG 画像を実装・検証する方法

すべての重要なページに固有の Open Graph と Twitter メタデータを追加してください。各ルートごとにカスタムのタイトル、説明、URL、ソーシャル画像を設定します。各ページにつき 1 枚の 1200×630 JPG 画像を使用し、検証項目og:imageとtwitter:imageをそれに合わせて更新してください。

- 任意の URL を共有する前に、次で表示内容を確認する:

- 重要な各ページの HTML に固有の

og:title、og:description、og:image、og:urlが設定されている - タグに

twitter:cardとtwitter:imageが含まれている - プレビューに正しいタイトル、説明、画像が表示される

- 画像は 1200×630px で、1MB 未満である

- ブランドと視覚的に一貫性がある

- すべてのページで 1 つの汎用画像を使い回さない

パフォーマンスとモバイル:読み込み速度とユーザー体験を向上させる

Core Web Vitals とパフォーマンス

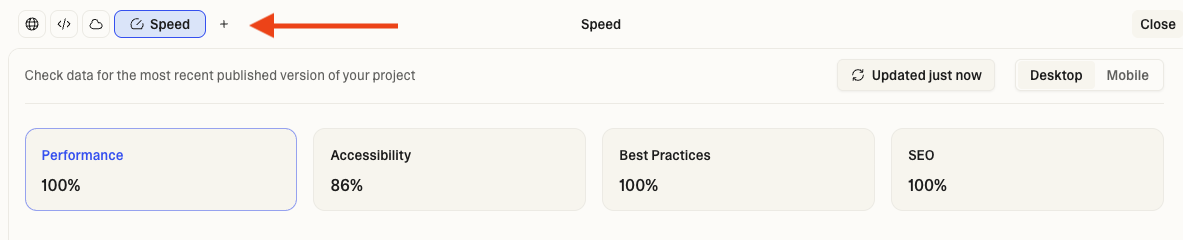

- Lovable の 組み込み Speed ツール(Google Lighthouse 搭載)を使って、サイトのパフォーマンス、アクセシビリティ、ベストプラクティス、SEO チェックを分析します。

- Google Search Console を使って Core Web Vitals を検証します。これは、読み込みパフォーマンス、インタラクティビティ、ページの視覚的安定性に関する実際のユーザー体験を測定する一連の指標です。

Core Web Vitals とパフォーマンスを最適化・検証する方法

Core Web Vitals とパフォーマンスを最適化・検証する方法

画像を圧縮し、width/height 属性を追加し、必須ではないスクリプトの読み込みを遅らせ、重要なアセットをプリロードして、ホームページのパフォーマンスを改善してください。Lighthouse の Performance スコア 90 以上を目標にしてください。検証

- Lovable で Speed ツールを実行(Google Lighthouse 監査)

- 目標スコア:

- Performance: 90+

- Accessibility: 90+

- Best Practices: 90+

- SEO: 100

- パフォーマンススコアが低いページを改善

- GSC で Core Web Vitals の目標値を確認・修正:

| Metric | Target | What it measures | How to fix |

|---|---|---|---|

| LCP (Largest Contentful Paint) | 2.5 秒未満 | 読み込みパフォーマンス(メインコンテンツが表示されるまでの時間) | ヒーロー画像を圧縮する、WebP を使用する、重要なリソースをプリロードする、サーバーレスポンス時間を短縮する |

| INP (Interaction to Next Paint) | 200 ミリ秒未満 | ユーザー操作に対してページがどれだけ素早く反応するか | JavaScript の実行時間を短縮する、重要ではないスクリプトを遅延読み込みする、長時間タスクを分割する |

| CLS (Cumulative Layout Shift) | 0.1 未満 | 読み込み中の視覚的な安定性 | すべての画像に width/height を指定する、動的コンテンツ用のスペースを確保する、ファーストビュー内への読み込み後の挿入を避ける |

モバイル最適化

viewport タグ付きのレスポンシブレイアウトを生成します。モバイル向けの適切なスケーリングには viewport タグが必須です。

モバイルパフォーマンスを最適化・検証する方法

モバイルパフォーマンスを最適化・検証する方法

モバイルでのユーザー体験を確認してください。タップ領域のサイズを最低 48x48px に拡大し、インタラクティブ要素同士の間に余白を追加し、テキストは最小 16px にし、小さい画面で発生する横スクロールをすべて解消してください。検証

- Chrome DevTools と 実機 を使って、複数のデバイスサイズで主要ページをテストする — iPhone、Android、タブレットサイズでテストする

- すべての主要なフローがモバイルでスムーズに動作することを確認する

- どのページでも横スクロールが発生しない

- ズームしなくてもテキストが読める(フォントサイズは最低 16px)

- ボタンとリンクは少なくとも 48×48px で、間に余白があり、タップしやすいこと

- フォームがタッチデバイスで正しく動作する(大きめの入力欄、わかりやすいラベル)

- ナビゲーションにアクセスしやすい(ハンバーガーメニューが正常に機能している)

- 画像や動画が画面幅に収まっている

-

viewportタグが存在することを確認する。 ブラウザコンソールに次を貼り付ける:すると次のように表示されます:

GEO: コンテンツを AI/LLM に最適化する

AI 向けのセマンティック HTML とスキーマ

AI 向けセマンティック HTML とスキーマの実装と検証方法

AI 向けセマンティック HTML とスキーマの実装と検証方法

重要な情報が、見出しが明確なプレーン HTML で記述されていることを確認するために、ホームページをチェックしてください。名前、説明、URL、ロゴ、ソーシャルメディアのリンクを含む Organization スキーマを追加してください。

検証- 主要な事実は静的 HTML に記述する(例:何をしているか、誰向けか、料金)

- 情報の構造化には明確な見出し(H2、H3)を使用する

- 網羅的なスキーマを追加する:

Organization、Product、FAQPage、Article - AI が解析・引用しやすい、明確で事実ベースの文章で記述する

- サイト全体、スキーマ、外部プロフィール間で事実を一貫させる

AI ボットのアクセス (robots.txt)

robots.txt を設定し、必要なボットのみを許可できます。

robots.txt での AI ボットアクセスの実装と検証方法

robots.txt での AI ボットアクセスの実装と検証方法

robots.txt を更新して、GPTBot、PerplexityBot、Claude-Web を許可し、Google-Extended と CCBot をブロックしてください。標準的な検索エンジンのクローラーはすべて許可されたままにします。

検証手順- 公開戦略を決める: AI による引用を許可するか、AI 学習をブロックするか

- 戦略に基づいて、ボットを明示的に許可またはブロックする

- よく利用されるボット: GPTBot (ChatGPT)、PerplexityBot、Claude-Web、Google-Extended (training)、CCBot

- 変更後に再確認し、必要なボットが誤ってブロックされていないことを確認する

LLM が引用しやすいコンテンツパターン

LLM に引用されやすいコンテンツパターンを実装して検証する方法

LLM に引用されやすいコンテンツパターンを実装して検証する方法

FAQ の回答を、短く、端的で、AI が引用しやすい形に更新してください。最初に主な回答を書き、具体的な事実を含め、あいまいなマーケティング表現は削除してください。検証項目

- FAQ/Q&A 形式で、よくある質問に対して明確な回答を書く

- “X is [clear definition]” のような、引用しやすい定義パターンを使う

- あいまいなマーケティング文言を避ける

- 読み取りやすいように、リストや箇条書きを作成する

- 可能であれば、出典付きの統計情報を含める

- 悪い例:

Amazing transformative solutions - 良い例:

USDA-certified organic dog food delivered weekly. Plans start at $45/month with free shipping over $50.

静的な LLM 向け要約ページ

静的な LLM 向け要約ページの実装と検証方法

静的な LLM 向け要約ページの実装と検証方法

検証publicフォルダー配下に静的なllm.htmlページを作成し、会社が何をしているのか、何を提供しているのか、他社との違い、料金の概要、FAQ、連絡方法を分かりやすく説明してください。OrganizationとFAQPageのスキーマを追加し、ページをシンプルな H2/H3 見出しで構成してください。この新しい URL を sitemap.xml に含めてください。

- ページが

/llm.htmlや/about-ai.htmlなどの分かりやすい URL で作成されている。 - ページが

sitemap.xmlに含まれている。 - コンテンツが分かりやすい H2/H3 見出しで構造化されている。

- ページに含まれるべき主要情報: 会社概要、プロダクト/サービス、差別化要因、料金モデル、連絡先情報、FAQ。

- AI システムが構造化された事実を抽出できるように、

OrganizationとFAQPageのスキーマが設定されている。 - コンテンツが事実に基づいており、簡潔で引用しやすいものである(マーケティング的な誇張は避ける)。

- 提供内容の変更に合わせて情報が最新の状態に保たれている。

監視とメンテナンス: SEO と GEO を健全に保つ

Google Search Console (GSC) の設定

モニタリングとメンテナンスのための GSC の設定と使い方

モニタリングとメンテナンスのための GSC の設定と使い方

- DNS TXT レコード(推奨):ドメインプロバイダの DNS 設定に TXT レコードを追加

- メタタグによる確認:Lovable にメタタグを追加するようプロンプトする

GSC の確認用メタタグを追加: <meta name=‘google-site-verification’ content=‘YOUR_CODE’ /> を <head> に追加

- HTML ファイルのアップロード:Google の確認ファイルをアップロードし、Lovable にサイトルート(通常は

/public)に配置するよう依頼

- GSC で Sitemaps に移動

- サイトマップ URL を入力:

https://yourdomain.com/sitemap.xml - Submit をクリック

- Google が実際のコンテンツ(空白ページではないもの)を見ているか確認する

- CSR(クライアントサイドレンダリング)の問題を診断する

- 重要なリソース(JavaScript や CSS)がブロックされていないか確認する

- URL Inspection バーに URL を入力

- Test Live URL をクリック

- View Tested Page を開き、次を確認:

- Googlebot が見ているスクリーンショット

- レンダリング後の HTML

- コンソールエラー

- ブロックされているリソース

- 新規または更新されたページについては Request Indexing をクリック(レート制限あり)

- Coverage/Page indexing(カバレッジ/ページのインデックス登録):

- インデックス済みページと除外されたページ

- クロールエラーと除外理由

- インデックス状況の推移

- Performance(search results/検索パフォーマンス):

- 表示回数、クリック数、CTR、平均掲載順位

- 上位のクエリとページ

- 可視性が向上・低下しているページ

- Core Web Vitals:

- 実環境での LCP、INP、CLS

- 低速または問題のあるページの特定

- モバイルとデスクトップのパフォーマンスを比較

- Mobile usability(モバイルユーザビリティ):

- タップターゲット、ビューポート、コンテンツ幅に関する問題

- エラーを修正してモバイル検索順位を維持

推奨メンテナンススケジュール

メンテナンススケジュール:毎週・毎月・四半期ごとに確認すること

メンテナンススケジュール:毎週・毎月・四半期ごとに確認すること

- GSC の「カバレッジ」で新しいエラーと新規インデックス済みページを確認する

- 検索パフォーマンスのトレンドをざっと確認する

- 新たに重要になった URL に対して URL 検査を実行し、必要に応じてインデックス登録をリクエストする

- ページが変わった場合は

sitemap.xmlを更新する - 成果が出ていないタイトルとディスクリプション(CTR が低いページ)を見直す

- 組み込みの Speed tool(Lighthouse 監査) を実行する

- 小規模なコンテンツ改善や被リンク獲得(リンクビルディング)を行う

- より深い技術的なサイト監査を行う:正規 URL 設定(canonical)、

robots.txt、スキーマ、内部リンク、モバイルユーザビリティ - キーワードのパフォーマンスと主要なランディングページを確認する

- 古いコンテンツやパフォーマンスが落ちているコンテンツをリフレッシュする

よくある質問

Lovable で作ったサイトは、検索結果で上位表示されますか?

Lovable で作ったサイトは、検索結果で上位表示されますか?

Lovable で最高の SEO と GEO の結果を得るにはどうすればよいですか?

Lovable で最高の SEO と GEO の結果を得るにはどうすればよいですか?

- 独自性があり高品質なコンテンツを書く

- 明確な検索意図とロングテールキーワードを狙う

- 必要に応じて網羅的なページを作成する

- コンテンツを常に最新かつ関連性の高い状態に保つ

- 見出し構造を整理し、セマンティックな HTML を使う

- 重要なページには JSON-LD スキーマを追加する

- 容量の大きな画像は圧縮する

- 説明的な alt テキストを追加する

- 効率的な形式(WebP/AVIF、SVG)を使用する

- 説明的でキーワードを含んだアンカーテキストを使う

- 関連するページ同士をリンクする

- 重要なページには複数の内部リンクが集まるようにする

- Core Web Vitals を最適化する

- 組み込みの Speed ツール を使ってパフォーマンスの劣化を早期に検知する

- モバイルでも問題なく利用できるようにする

- すべてのページに正しいメタデータを設定する

- 正確な sitemap と robots.txt を維持する

- 独自ドメイン を使用し、それを プライマリドメイン に設定する

- Google Search Console でドメインの所有権を確認する

- ガイド、ツール、調査など、リンクしたくなるコンテンツを作成する

- 関連サイトにゲスト投稿を書く

- 補完関係にあるビジネスと提携する

- 信頼できるディレクトリにサイトを掲載する

- ニュース性のあるアップデートを共有し、コミュニティと積極的に交流する

Google にページがインデックスされるまで、どのくらい時間がかかりますか?

Google にページがインデックスされるまで、どのくらい時間がかかりますか?

- GSC にサイトマップを送信する

- URL 検査でページをテストする

- 優先度の高いページでは インデックス登録をリクエスト を利用する

自分のページの順位が表示されない場合は?

自分のページの順位が表示されない場合は?

- Coverage レポートまたは URL 検査を使って、GSC 上でインデックス状況を確認する

- サイトマップを送信済みで、その URL が含まれていることを確認する

- コンテンツの品質、検索意図との整合性、タイトル・ディスクリプション・見出し・内部リンクなどのオンページ SEO を見直す

- 技術的な健全性を確認する:パフォーマンススコアが良好であること、モバイルで問題なく利用できること、JavaScript や CSS がブロックされていないこと

SEO や GEO の観点で Lovable が適しているのはどのようなケースで、SSR やプリレンダリングを検討すべきなのはどのようなケースでしょうか?

SEO や GEO の観点で Lovable が適しているのはどのようなケースで、SSR やプリレンダリングを検討すべきなのはどのようなケースでしょうか?

適しているシナリオ

- マーケティングサイトやランディングページ

- スタートアップやビジネス向けのウェブサイト

- シンプルなブログやドキュメントサイト(約 200 ページまで)

- ポートフォリオサイトや個人サイト

- 内部ツールやダッシュボード(SEO 不要)

- 認証の裏側にあるアプリ(インデックスさせるべきではない)

- メタデータ管理が容易な小規模サイト(5〜20 ページ)

- リファラル、ソーシャルトラフィック、広告チャネル、プロダクト主導型グロースに依存するプロジェクト

- 継続的にメンテナンスされるコンテンツ主導のブログ(記事数 約 50 本以上)

- メタデータを丁寧に管理できる中規模 EC サイト(数百点のプロダクト)

- ページ数が管理可能な範囲で、メタデータやサイトマップを正確に保てる

- Google は CSR(クライアントサイドレンダリング)サイトも安定してレンダリングするため、コンテンツはインデックスおよびランキング可能

- Lovable 上でのパフォーマンスとモバイル最適化がシンプル

- タイトル、ディスクリプション、スキーマ、OG タグ、内部リンクなど、重要な要素を手動で維持できる

SSR やプリレンダリングが有効になる場合

一部の大規模または競争の激しいプロジェクトでは、サーバーレンダリングやプリレンダリングされたページを Lovable と組み合わせて活用することで、クロール効率やプレビューの信頼性を高めることができます。- 非常に大規模なサイト(数百〜数千ページ、大規模カタログ、膨大なブログライブラリなど)

- オーガニック検索が主な成長チャネルであるプロジェクト

- 競争が激しい、または時間依存性の高い分野(ニュース、金融、法務)

- AI / LLM での最大限の可視性が優先事項となるプロジェクト

- 大規模サイトでは、メタデータやサイトマップの自動化が不可欠

- SSR / プリレンダリングは、検索エンジンによる初回コンテンツ発見を高速化できる

- JavaScript を実行しないソーシャルや AI クローラーでも、完全なプレビューを即座に取得できる

独自ドメインを利用すると、サイトの検索順位は上がりますか?

独自ドメインを利用すると、サイトの検索順位は上がりますか?

- オーガニック検索からのトラフィック

- 強力で長期的なブランディング

- 競争力のある SEO

- 時間とともに価値が高まる被リンク

- テクニカル SEO を自在にコントロールできること

- 自分のドメインまたはサブドメインを接続する

- 1つのプライマリドメインを選ぶ(他のすべてのドメインはそこへリダイレクトされます)

lovable.app サブドメインは次のような用途に適しています:- MVP やデモ

- 一時的または実験的なランディングページ

- 社内ツール

- 主にソーシャル経由や広告からのトラフィックに依存するプロジェクト

AI検索エンジン(Perplexity、ChatGPT、Gemini、Claude)はLovableアプリをインデックスできますか?

AI検索エンジン(Perplexity、ChatGPT、Gemini、Claude)はLovableアプリをインデックスできますか?

- 重要な事実を静的コンテンツとして含めた、クリーンでセマンティックな HTML

- 包括的な schema マークアップ

/llm.htmlや/about-ai.htmlといった LLM 向けの専用サマリーページ(sitemap にも含める)- 明確で引用しやすいコンテンツ(定義、FAQ、簡潔な事実ベースの回答)

SEO設定、コンテンツ、サイトマップはどのくらいの頻度で更新すればよいですか?

SEO設定、コンテンツ、サイトマップはどのくらいの頻度で更新すればよいですか?

- サイトマップ: URL が変更されたタイミング、またはアクティブなサイトでは少なくとも月に 1 回更新します。

- メタデータ(タイトルとディスクリプション): 毎月見直して、クリック率が低いページを改善します。

- パフォーマンス: 月に 1 回 Lighthouse チェックを実行し、Core Web Vitals(LCP、INP、CLS)を確認して、速度やユーザビリティの問題を早期に発見します。

- 技術監査: カノニカル、robots.txt、スキーマ、内部リンク、リダイレクト、モバイルユーザビリティを四半期ごとにレビューします。

- コンテンツ: 重要なコンテンツは四半期ごと、またはランキングやトラフィックが下がった場合はそれより早く更新または拡充します。

プリレンダリングとは何か、いつ必要になるのか?

プリレンダリングとは何か、いつ必要になるのか?

- コンテンツ量の多いサイト

- 新しいページを頻繁に公開するサイト

- SEO を重視した、競合の激しいニッチ領域

- より速いインデックス登録が必要なプロジェクト

- 多くのクローラーが JavaScript を実行せず、完全にレンダリングされた HTML から恩恵を受けるため、AI/LLM 向けの可視性を高めたい場合

- Prerender.io:広く使われている信頼性の高いオプション

- DataJelly:シンプルなセットアップで同様の機能を提供

- Rendertron:オープンソースの代替手段(セルフホスト型)

CSR の SEO における主な制約と、その回避方法は?

CSR の SEO における主な制約と、その回避方法は?

- インデックス登録は SSR より少し遅くなる場合があります → サイトマップを送信し、優先度の高いページには URL Inspection ツールを使いましょう。

- 多くの AI クローラーや一部のボットは JavaScript を実行しません → セマンティックな HTML と適切なスキーマを使い、必要に応じて LLM 向けの要約ページの追加も検討してください。

- ソーシャルプラットフォームはリンクプレビューのために JavaScript を実行しません → 静的 HTML に直接 Open Graph と Twitter/X Card タグを追加してください。

- ルート間でメタデータが自動更新されません

→ Lovable に

react-helmet-asyncのインストールを依頼し、各ページごとに一意の title と description を設定してください。